新しいAI攻撃ベクトル

新しいパイプラインとインフラストラクチャを実装する際に、統合された可視性が欠如していると、組織は新しい攻撃を受けやすくなります。

新しいAI攻撃ベクトル

新しいパイプラインとインフラストラクチャを実装する際に、統合された可視性が欠如していると、組織は新しい攻撃を受けやすくなります。

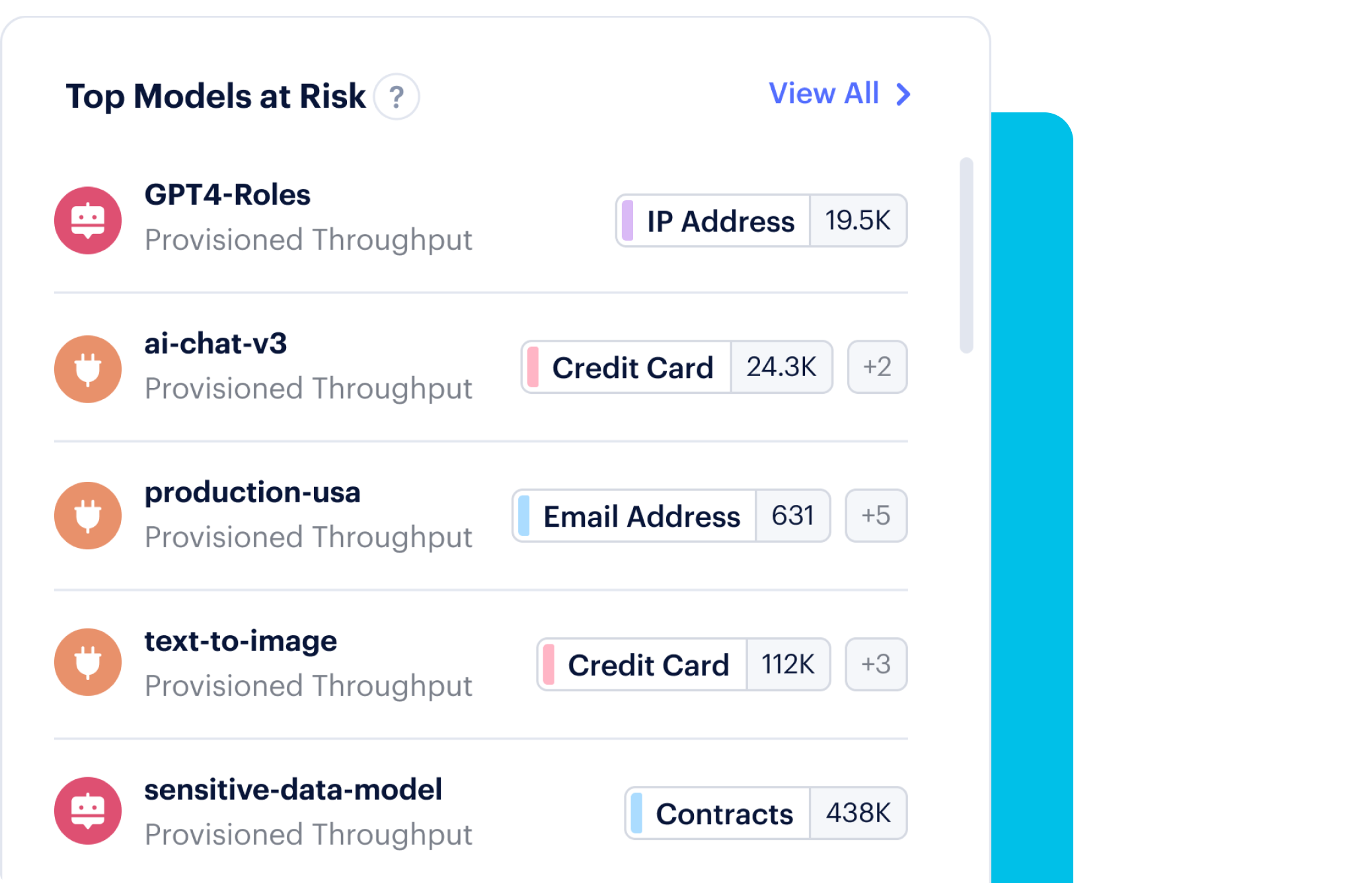

モデルの無秩序な拡散の問題への対処

AIインベントリがなければ、シャドーAIモデル、コンプライアンス違反、AI利用アプリケーションを通じたデータ流出の発生につながります。

ガバナンスの欠如

AIに重点を置いた新しい法律では、AIの使用法と、AI利用アプリケーションに供給される顧客データに関して厳格な制御が義務付けられています。

組織をリスクにさらすことなく、AIと大規模言語モデル(LLM)の革新的なメリットを最大限に生かします。 Prisma® CloudのAIセキュリティ体制管理(AI-SPM)により、AIセキュリティの3つの重要な構成要素、つまりトレーニングや推論に使用するデータ、AIモデルの整合性、導入したモデルへのアクセスを可視化して制御できます。

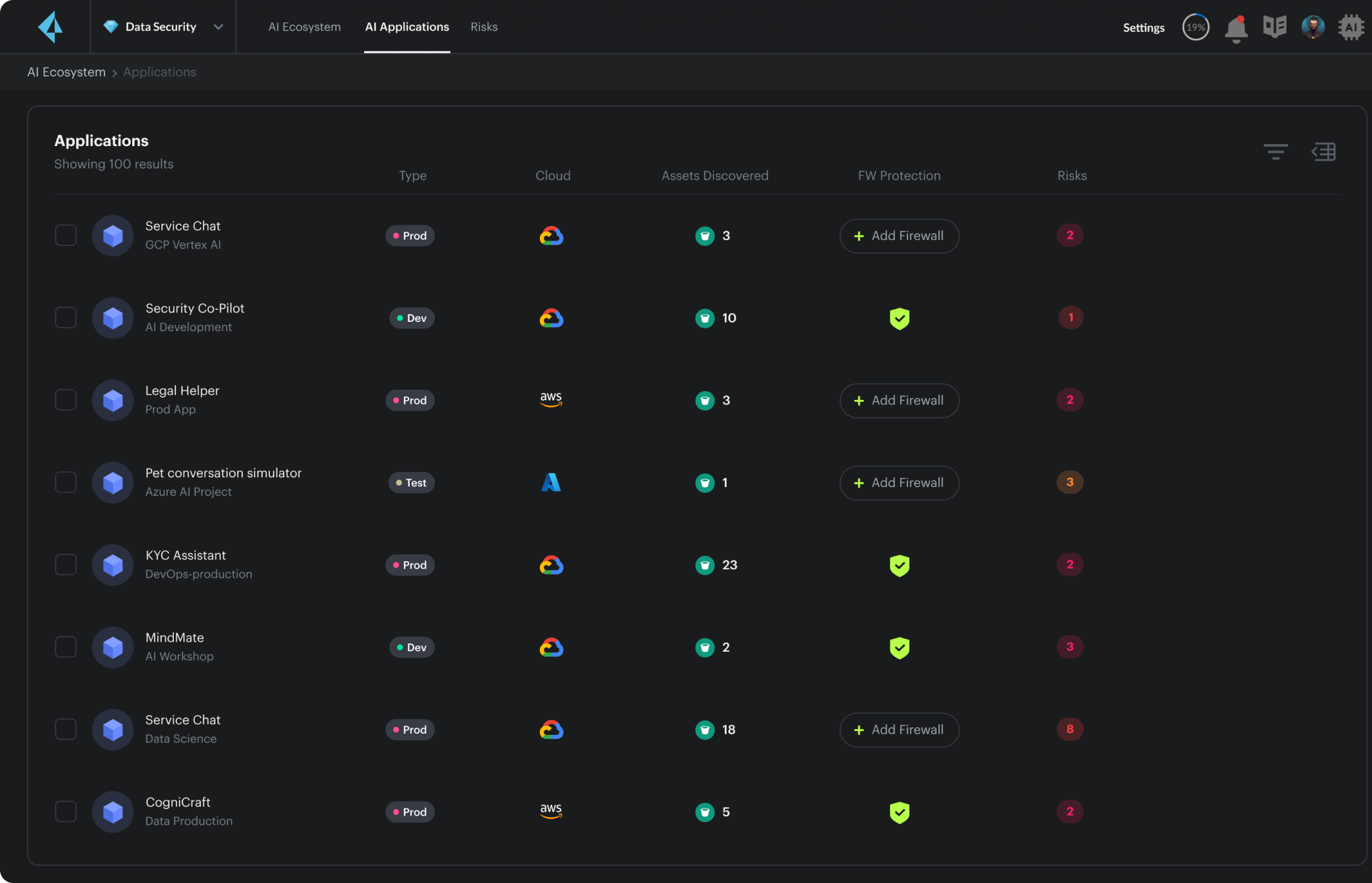

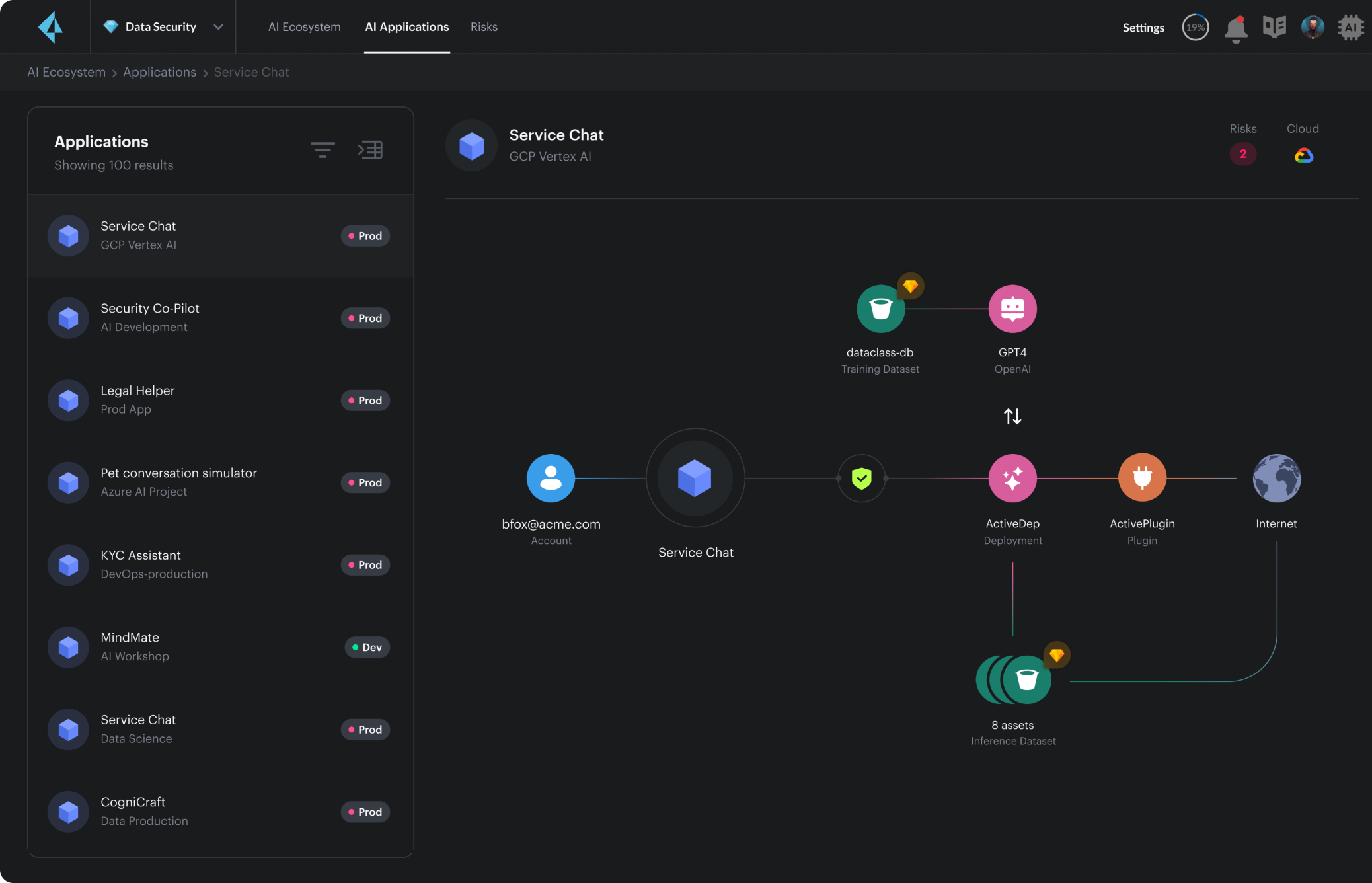

AIアプリケーション、モデル、関連リソースをすべて検出します。アプリケーションで使用されているAIコンポーネントのリネージュを特定し、追跡します。

AIアプリ スタックの検出

AIアプリケーション、モデル、関連リソースをすべて検出します。

AIリネージュ

アプリケーションで使用されているAIコンポーネントとデータ ソースのリネージュを特定し、追跡します。

モデル インベントリ

導入されているAIモデルのカタログを作成し、更新を確認します。

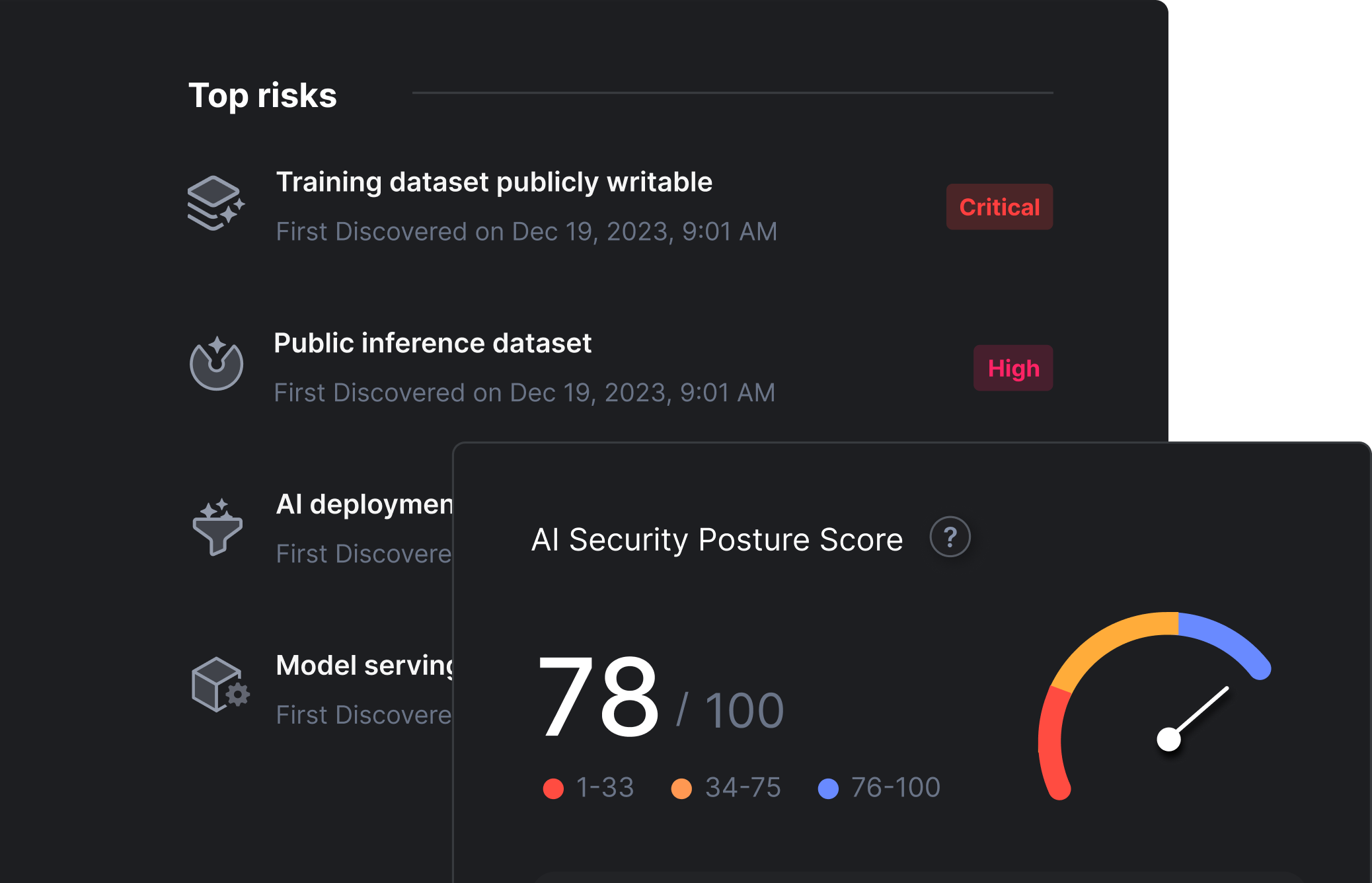

AIサプライ チェーンの脆弱性を特定し、操作、悪用、窃取を招く可能性がある設定ミスのあるモデルと関連クラウド リソースを見つけます。

モデルの侵害と窃取の防止

敵対者が機能的に同等なモデルを作成するリスクを特定。

設定ミスの検出

過剰な権限が付与されたコンピューティング インスタンスとモデルを削減。

安全でないプラグイン設計の回避

過剰な権限が付与された脆弱なエージェント/ワークロードを特定。

モデル データの操作により脆弱性と偏りが生じ、データが公開され、データ プライバシー侵害、コンプライアンスとセキュリティのリスクを招く可能性があります。

AIスタックの分類

AIモデルを駆動するトレーニング データや参照データ、ライブラリ、API、データ パイプラインのどこに機密データが存在するかを特定します。

機密データの監視

データの公開、ポイズニングのリスク、プライバシー侵害、セキュリティ侵害を監視し、管理します。

脆弱性の優先順位付け

機密データにアクセスしているAIをホストするインフラストラクチャ内の脆弱性。